🌟 限时注册,获取特殊福利! 🌟

我们为新用户准备了独特的福利,只需在注册通过链接即可获取! 注册链接: 点击这里注册

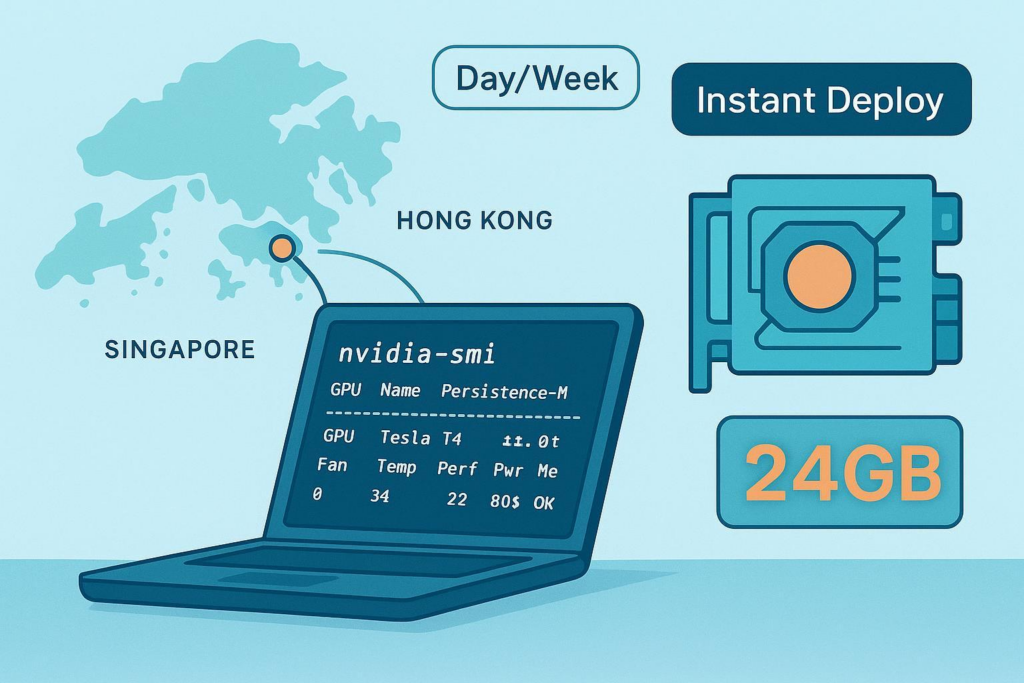

如果您正在为亚太地区的用户进行构建,那么让推理靠近您的受众是缩短响应时间和加速迭代的最快方法。本实践指南展示了海外/亚太地区开发人员如何使用在香港或新加坡租赁的亚太地区低延迟 GPU 在 24-168 小时窗口内完成小型微调和推理部署。我们将优先考虑即时部署、隐私友好型入门(无需正式身份检查;在提供商支持的情况下进行加密友好型支付)以及适合单个 24GB GPU 的实用模型选择。

为什么香港和新加坡会出现亚太地区的延迟

香港和新加坡是该地区公认的互连中心,拥有密集的数据中心生态系统、云入口和海底电缆登陆点,可实现亚太地区的低延迟路由。 Equinix 在其亚太地区托管概述 中将这些都市圈描述为亚太地区托管和互连的核心。 Console Connect 还在其 2024 年对等互连更新 中撰写了有关 HKIX 和 DE-CIX 新加坡等亚太地区交易所扩大对等互连机会和 100G 端口的文章。

您今天如何确认最适合您的用户的区域?在提交日或周计划之前运行快速延迟检查:

-

从您的客户端位置,对两个区域中的测试服务器或云实例执行 ping 操作;选择 RTT 较低的一个。

-

使用 iPerf3 测量吞吐量和抖动:在实例上,

iperf3 -s;从您的客户端,“iperf3 -c”或 UDP 模式“iperf3 -c -u -b 1M -t 10”。请参阅iPerf3 文档。

短期运行时选择哪种 GPU

以下两个选项均提供 24GB VRAM。您的选择应遵循工作负载适合度和预算:

-

RTX 40 级(例如 RTX 4090 24GB):强大的单 GPU 性能,可用于微调中小型模型和高吞吐量推理。在一次冲刺中混合训练+推理的良好默认设置。

-

Tesla P40 24GB:较旧的企业 GPU,对于推理和轻量级微调通常具有成本效益。如果您的工作负载主要是推理或小型适配器,那么这可能是一个务实的选择。

可以这样想:如果您的 24-168 小时计划包括几个小时的训练和发球,则精益 RTX 40;如果是推理优先且适度调整,P40 可以延长预算。

亚太地区低延迟 GPU 租赁快速入门:日/周微管道分五个步骤

以下是使用 Docker 和 NVIDIA Container Toolkit 的提供商中立工作流程。预计完成时间:1-3 小时的设置,然后根据数据大小进行 1-6 小时的微调。

- 在香港或新加坡启动GPU实例

- 选择最接近最终用户的区域(使用 ping/iPerf 验证)。确保您未来的 API 具有公共 IP 和开放端口。

- 在主机上安装/验证 NVIDIA Container Toolkit

-

遵循NVIDIA 的安装指南,然后配置 Docker 运行时:

sudo nvidia-ctk runtime configure && sudo systemctl restart docker。 -

验证容器中的 GPU 可见性:

docker run --rm --gpus all nvidia/cuda:12.4.1-base-ubuntu22.04 nvidia-smi。

3.准备工作容器环境

- 使用常见的 ML 工具启动基础容器:

““

docker run -it –rm –gpus all \

-p 8000:8000 \

-v $HOME/work:/work \

nvidia/cuda:12.4.1-base-ubuntu22.04 bash

容器内部

apt-get update && apt-get install -y python3-pip git

pip3安装–升级pip

pip3 安装 torch torchvision –index-url https://download.pytorch.org/whl/cu124

pip3 安装 Transformer 加速 peft bitsandbytes vllm fastapi uvicorn

““

- 在 7B–9B 模型上运行最小微调 (LoRA/QLoRA)

- 使用 4 位加载以适应 24GB 以内,并保持较小的批量大小:

““

train_lora.py(最小草图)

进口火炬

从 Transformer 导入 AutoModelForCausalLM、AutoTokenizer

从 peft 导入 LoraConfig,getpeftmodel

从变压器导入 BitsAndBytesConfig

model_name = “Qwen/Qwen2.5-7B-Instruct” # 示例:查看型号卡

bnb_cfg = BitsAndBytesConfig(

loadin4bit=真,

bnb4bitquant_type =“nf4”,

bnb4bitcompute_dtype=torch.bfloat16,

bnb4bitusedoublequant=真,

)

模型 = AutoModelForCausalLM.from_pretrained(

型号名称,

量化配置=bnb_cfg,

device_map =“自动”,

)

loracfg = LoraConfig(r=8, loraalpha=16, loradropout=0.05, targetmodules=[“qproj”,”vproj”]) # 调整每个模型的目标

模型 = getpeftmodel(模型, lora_cfg)

TODO:分词器、数据集加载器、梯度累积训练循环、/work/checkpoints 的频繁检查点

““

注意:bitsandbytes 运行时量化通常不使用“save_pretrained()”保存;使用相同的配置重新加载或考虑使用 AWQ/GPTQ 来获得永久的量化工件。请参阅高频文档。

- 使用 vLLM 进行推理(兼容 OpenAI)

““

仍在容器内

vllm 服务 Qwen/Qwen2.5-7B-Instruct –主机 0.0.0.0 –端口 8000

““

- 使用简单的卷曲进行测试:

““

curl -X POST http://

-H“内容类型:application/json”\

-d'{

“model”: “Qwen/Qwen2.5-7B-指令”,

“messages”:[{“role”: “user”, “content”: “来自亚太地区的你好!”}],

“最大令牌”:64

““

如果您的客户端的延迟感觉不和谐,请尝试其他区域并进行比较。

实际示例:香港或新加坡的端到端一日游计划

披露:SurferCloud 是我们的产品。该平台支持即时部署、香港 (RTX 40) 和新加坡 (Tesla P40) GPU 可用性、按小时/按天/按周计费以及无限带宽。有关帐户设置和控制台步骤(SSH 密钥、安全组),请参阅此分步部署指南。

-

启动:当您期望混合训练 + 推理时,在香港启动 RTX 40 天计划;选择新加坡的 Tesla P40 进行推理优先运行。

-

验证 GPU:通过 SSH 登录并运行

nvidia-smi;然后运行 Dockernvidia/cuda测试。 -

微调:使用上面的最小 LoRA 脚本和小数据集;检查点适配器到已安装的卷或外部对象存储。

-

服务:在端口8000上暴露vLLM;通过curl 确认与OpenAI 兼容的响应。

-

延迟检查:从客户端运行“ping”和“iperf3”,以确保响应时间满足您的目标。

-

清理:停止容器,保留检查点,根据需要对实例进行快照,并在空闲时关闭以控制成本。

模型注释:ChatGPT API、GLM-4.5 变体、Qwen

-

ChatGPT API:如果您的用例集成了 OpenAI 的 ChatGPT API,您可以单独进行训练,只部署一个轻量级服务器作为代理或任务编排器; API 本身不需要 GPU。

-

GLM-4.5:考虑用于单 GPU 实验的 GLM-4.5-4B 或 GLM-4.5-9B 变体;检查官方模型卡(GLM-4.5-4B、GLM-4.5-9B)并在适当的情况下使用bitsandbytes 4位或AWQ/GPTQ。

-

Qwen:Qwen2.5-7B-Instruct 是 24GB 的实用起点;请参阅官方模型卡。在训练或服务之前,请务必确认每张卡的内存需求和支持的量化。

故障排除要点

-

GPU 在容器中不可见:确保已安装 NVIDIA Container Toolkit 并配置 Docker 运行时;使用“docker run –rm –gpus all nvidia/cuda:12.4.1-base-ubuntu22.04 nvidia-smi”进行测试。请参阅NVIDIA 的故障排除指南。

-

CUDA/驱动程序不匹配:优先选择与主机驱动程序匹配的最新 CUDA 基础映像;请参阅NVIDIA 安装指南。

-

微调/推理期间内存不足:减少批量大小和序列长度;应用 4 位加载;使用 LoRA 适配器;通过“nvidia-smi”监控 VRAM。请参阅PEFT LoRA 方法 和Transformers 文档。

-

客户端的高延迟:切换区域(HK 与 SG)、在 vLLM/SGLang 中启用批处理以及使用 iPerf3 测试网络状况。

成本/时间卫生和清理清单

日计划(24 小时)适合快速实验、小型 LoRA 微调和短期推理验证。周计划(168 小时)适合扩展测试和更强大的端点强化。实用卫生:

-

调整大小:根据训练与推理平衡选择 GPU。

-

避免空闲时间:在不积极训练或服务时关闭实例。

-

频繁检查点:将适配器和模型状态保存到持久卷或外部存储。

-

需要时创建快照:在关机前创建快照以便稍后恢复。

-

释放资源:停止容器、释放所有保留的 IP 并清理存储。

下一步去哪里

- 准备好尝试日或周计划并请求试用了吗?访问SurferCloud 联系页面。

|计划| GPU 模型 |显存 |计算能力|图形处理器 |中央处理器和内存 |带宽|磁盘|持续时间 |地点 |价格|部署|

| RTX40 GPU 日 | RTX40 | 24GB | 83 万亿次浮点运算 | 1 | 16C 32G | 2Mbps | 200G固态硬盘| 24 小时 |香港 | 4.99 美元/天 |立即订购 |

|特斯拉 P40 日 |特斯拉 P40 | 24GB | 12 万亿次浮点运算 | 1 | 4C 8G | 2Mbps | 100G固态硬盘| 24 小时 |新加坡 | 5.99 美元/天 |立即订购 |

| RTX40 GPU 周 | RTX40 | 24GB | 83 万亿次浮点运算 | 1 | 16C 32G | 2Mbps | 200G固态硬盘| 168 小时 |香港 |每周 49.99 美元 |立即订购 |

|特斯拉 P40 周 |特斯拉 P40 | 24GB | 12 万亿次浮点运算 | 1 | 4C 8G | 2Mbps | 100G固态硬盘| 168 小时 |新加坡 | 59.99 美元/周 |立即订购 |

🌟 限时注册,获取特殊福利! 🌟

我们为新用户准备了独特的福利,只需在注册通过链接即可获取! 注册链接: 点击这里注册