🌟 限时注册,获取特殊福利! 🌟

我们为新用户准备了独特的福利,只需在注册通过链接即可获取! 注册链接: 点击这里注册

可预测的 GPU 成本决定了早期人工智能项目的成败。如果您可以锁定每月费率并以相同价格续订,您就可以计划实验、启动试点并扩大生产,而无需预算紧张。对于特定的月度计划,当前的促销活动提供 75% 的折扣,并以相同的价格续订,每个账户每个型号仅限两个实例。该促销活动持续到 2026 年 6 月 30 日,其中包括影响您调整服务器大小和管理服务器方式的操作规则,详细信息如下。有关服务保证和区域的上下文,请参阅产品页面上的 GPU 云服务器概述和 SLA 详细信息: GPU 云服务器

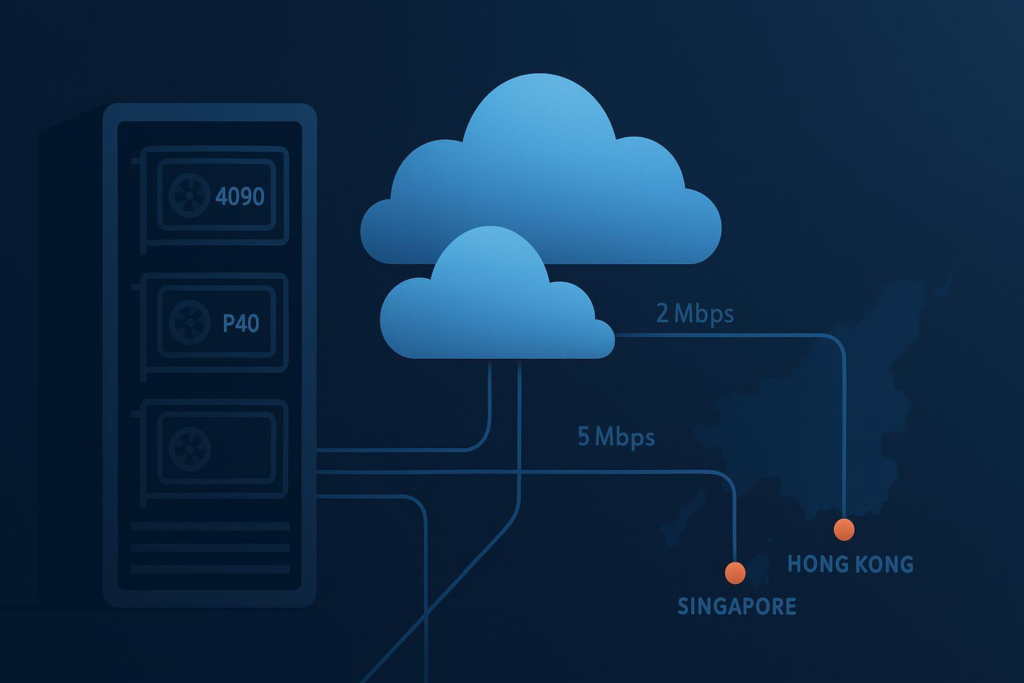

在本操作指南中,您将在香港的 RTX 4090 云服务器上设置可复制的容器化堆栈,并了解新加坡的 Tesla P40 何时更适合。您还将规划大约 2/5/10 Mbps 带宽等级,通过快速 GPU 测试进行验证,并了解促销规则,这样您就不会意外失去定价。

为您的工作负载选择合适的 GPU

RTX 4090(香港)和 Tesla P40(新加坡)都提供 24 GB VRAM,但它们在架构和加速方面有所不同。 RTX 4090 基于 Ada Lovelace,包括第四代 Tensor Core 和高内存带宽,这使其成为单 GPU 微调、混合精度训练/推理和高分辨率图像/视频生成的有力选择。有关一般架构摘要,请参阅 RTX 40 系列概述 相比之下,Tesla P40(Pascal)定位于推理和轻度训练;它缺乏 Tensor Core,但可为服务和中小型工作负载提供可靠的吞吐量,峰值 FP32 约为 12 TFLOPS,如 Tesla P40 数据表 (PDF) 所述。

您可以在内部比较文章中加深您的选择分析: P40 与 RTX 4090 可以这样想:如果您要微调 LLM 或生成高分辨率图像/视频,RTX 4090 云服务器通常会为您提供更大的空间和更短的迭代周期。如果您的主要需求是稳定、成本可控的推理或轻量级训练,新加坡的 Tesla P40 通常会达到最佳效果。

规划 2/5/10 Mbps 带宽

每月促销 SKU 包括 2、5 或 10 Mbps 等级。这些足以满足低 QPS 文本推理 API、控制平面流量和小型工件传输。但是,如果您直接通过实例的公共链接推送原始数据,批量数据集入口/出口将会很慢。最好的方法是围绕带宽进行设计:在计算附近预置数据集(例如,同一区域中的对象存储)并通过私有或优化路径拉取;使用可恢复下载和压缩 – huggingface-cli snapshot-download --resume 避免重新启动,rsync --partial 有助于处理片状链接,而 tar.gz 存档可减少传输开销;对于图像/音频响应,在服务时压缩、批量和交错交付。

如果您正在优化推理吞吐量和延迟,连续批处理、量化和运算符融合都是有用的技术 – 请参阅 LLM 推理性能工程最佳实践 获得简明概述。

预配和配置您的实例(可重现堆栈)

我们将使用 Docker 和 NVIDIA Container Toolkit 最大限度地减少主机漂移,然后使用小型 GPU 作业进行验证。

1.安装Docker(Ubuntu 22.04示例):

““

sudo apt-get 更新

sudo apt-get install -y ca-证书curl gnupg lsb-release

sudo mkdir -p /etc/apt/keyrings

卷曲-fsSL https://download.docker.com/linux/ubuntu/gpg | sudo gpg –dearmor -o /etc/apt/keyrings/docker.gpg

回声\

“deb[arch=$(dpkg –print-architecture) 签名者=/etc/apt/keyrings/docker.gpg] \

https://download.docker.com/linux/ubuntu $(lsb_release -cs) 稳定” | \

sudo tee /etc/apt/sources.list.d/docker.list > /dev/null

sudo apt-get 更新

sudo apt-get install -y docker-ce docker-ce-cli containerd.io

sudo usermod -aG docker $USER && newgrp docker

““

2.安装NVIDIA容器工具包:

按照 NVIDIA 的指南设置“nvidia-container-toolkit”、配置 Docker 运行时并重新启动 Docker: NVIDIA Container Toolkit 安装指南

快速运行时配置:

““

sudo nvidia-ctk 运行时配置 –runtime=docker

sudo systemctl 重新启动 docker

““

- 验证容器中的 GPU 可见性:

““

docker run –rm –gpus all nvidia/cuda:12.2.0-runtime-ubuntu22.04 nvidia-smi

““

您应该会看到列出的 RTX 4090 或 Tesla P40 以及驱动程序、CUDA 版本和利用率指标。

- 使用具有匹配 CUDA 的容器映像:

PyTorch 的通用基准是 CUDA 12.1 运行时映像。

““

docker run -it –rm –gpus all \

pytorch/pytorch:2.3.1-cuda12.1-cudnn8-运行时 \

python -c“导入火炬;打印(torch.cuda.isavailable(),torch.cuda.getdevice_name(0))”

““

如果“True”与您的设备名称一起打印,则堆栈连接正确。有关主机级安装和兼容性详细信息,请参阅 CUDA 安装指南

版本对齐备忘单(在生产前验证当前版本):

|司机 | CUDA |框架(示例)|

| —| —| —|

| ≥ 550.x | 12.2/12.3 | PyTorch 2.3/2.4 |

| ≥ 535.x | 12.1 | 12.1 PyTorch 2.2/2.3 |

实际示例 — 香港的一台 RTX 4090 云服务器

披露:SurferCloud 是我们的产品。首次提及时,请在此处查看当前促销详细信息: 每月 GPU 计划 75% 折扣

-

规定:在香港创建一个每月 RTX 4090 实例。选择您计划保留的系统磁盘大小(例如 200 GB)。如果稍后重新安装操作系统,则必须选择相同的磁盘容量,否则将产生额外费用。

-

带宽:根据您的入口和服务配置文件选择 2、5 或 10 Mbps。对于低 QPS 文本推理,2-5 Mbps 通常就足够了;如果您计划图像生成响应,10 Mbps 会有所帮助。

-

访问:通过 SSH 登录并安装 Docker 和 NVIDIA Container Toolkit。使用“docker run –rm –gpus all nvidia/cuda:12.2.0-runtime-ubuntu22.04 nvidia-smi”进行验证。

-

最小运行:启动 PyTorch 容器(

pytorch/pytorch:2.3.1-cuda12.1-cudnn8-runtime),确认torch.cuda.is_available(),然后拉取一个小型量化模型或 SD 1.5 管道以生成一个输出。 -

操作:如果您需要更多吞吐量,请考虑配置第二个实例(每个模型限制两个实例)和负载平衡请求。避免更改配置的升级 – 促销价将不再适用。

服务器通常会在几分钟内变得活跃;品牌材料表明许多激活在一分钟内完成,但在运行作业之前计划一个短暂的缓冲。

随着时间的推移扩展和控制成本

可预测的定价是这里的核心优势。通过以相同价格续订,您可以保持 RTX 4090 云服务器在线,以实现长期运行的微调管道、计划的批量生成或稳定的推理。

需要遵守的操作规则包括截至 2026 年 6 月 30 日的促销窗口;每月计划的每个型号最多有两个限制,多个帐户共享同一电话/电子邮件/IP,被视为一个用户;购买的产品和福利不可转让;重装操作系统时选择相同的系统盘容量(例如100GB或200GB)以避免产生费用;和配置更改限制——不能降级,升级则使促销价格无效,续订和升级遵循标准程序。

实用规划技巧:如果您预计缓存模型或容器,则在开始时保守地调整系统磁盘大小(例如 200 GB),以便保持符合重新安装规则;如果您预计负载会出现峰值,请在每个模型两个的限制内配置第二个实例,而不是升级单个盒子;有关 SLA 覆盖范围和区域选择,请参阅产品概述: **GPU 云服务器。

故障排除快速修复

如果 GPU 在 Docker 中不可见,请使用官方指南安装和配置 NVIDIA Container Toolkit,然后重新启动 Docker。对于驱动程序/CUDA 不匹配的情况,请将容器 CUDA 与驱动程序功能相匹配,并查阅 CUDA 安装指南 当您达到 VRAM 限制时,请减少批量大小、使用 8 位/4 位权重,并启用梯度检查点或累积训练。如果数据集入口很慢,请将数据暂存在附近的对象存储中、压缩存档并使用可恢复传输,而不是以超过 2/5/10 Mbps 的速度推送大文件。

常见问题解答 — 定价规则和采购

问:促销持续多久?

答:截至 2026 年 6 月 30 日。

问:我可以以相同的促销价格续订吗?

答:是的,在本次促销活动中,按月计划续订的价格相同。

问:我可以购买的实例数量有限制吗?

答:每月促销限制每个帐户每个模型两个实例。具有相同电话/电子邮件/IP 的多个帐户将被视为同一用户。

问:如果我重新安装操作系统会怎样?

答:您必须选择与原来选择的系统盘容量相同的系统盘容量(例如100GB或200GB),否则需要额外费用。

问:以后可以降级或升级吗?

答:不允许降级。如果升级配置,则不再享受促销价;续订和升级遵循标准购买程序。

问:隐私和付款选项会影响设置吗?

答:采购方面,账户不需要强制身份验证(无需KYC),并且支持常见的支付方式(USDT、支付宝、主流信用卡)。这种灵活性可以简化团队的入职和续约,但不会改变技术设置。

后续步骤:如果您准备好锁定可预测的价格并开始构建,请在促销页面上查看促销详细信息以及符合条件的 RTX 4090 云服务器和 Tesla P40 配置。请牢记规则,尤其是重新安装时的磁盘大小和每个模型两个的限制,以便您的成本模型在扩展时保持稳定。

🌟 限时注册,获取特殊福利! 🌟

我们为新用户准备了独特的福利,只需在注册通过链接即可获取! 注册链接: 点击这里注册